6 Min. Lesezeit

Ihr KI-Agent verliert in echten Gesprächen 39 % an Genauigkeit. Das herausragende Paper der ICLR 2026 erklärt, warum.

Jeder große LLM-Benchmark testet auf dieselbe Weise: ein Prompt hinein, eine Antwort heraus. Klar, kontrolliert, vollständig spezifiziert. Das Problem ist, dass fast keine KI-Anwendung in der Praxis so funktioniert. Enterprise-KI-Agenten führen mehrstufige Gespräche. Sie erfassen Anforderungen über mehrere Nachrichten hinweg, rufen Tools auf, verarbeiten Zwischenergebnisse und verdichten Informationen, die über Dutzende von Gesprächsrunden hinweg Stück für Stück offengelegt werden.

Das herausragende Paper von ICLR 2026, LLMs verirren sich in mehrstufigen Gesprächen, untersuchte, was passiert, wenn man LLMs so evaluiert, wie Agenten tatsächlich eingesetzt werden. Das Ergebnis: ein durchschnittlicher Genauigkeitsrückgang von 39 % über alle getesteten Modelle hinweg.

Das Experiment

Die Forscher Philippe Laban, Hiroaki Hayashi, Yingbo Zhou und Jennifer Neville entwickelten ein Framework, um Standard-Benchmarks mit einem einzelnen Turn in mehrstufige Gespräche umzuwandeln. Sie nahmen vollständig spezifizierte Anweisungen, zerlegten sie in atomare Informationsbausteine namens „Shards“ und nutzten einen LLM-basierten Simulator, um pro Turn jeweils ein Stück im natürlichen Gesprächsfluss offenzulegen.

Die Größenordnung war beträchtlich: über 200.000 simulierte Gespräche über 15 Modelle von acht Anbietern hinweg, darunter GPT-4.1, Claude 3.7 Sonnet, Gemini 2.5 Pro, DeepSeek-R1 und Llama 4-Scout. Sechs Aufgabentypen deckten Coding, SQL-Abfragen, Function Calling, Mathematik, Textgenerierung aus Daten und die Zusammenfassung mehrerer Dokumente ab.

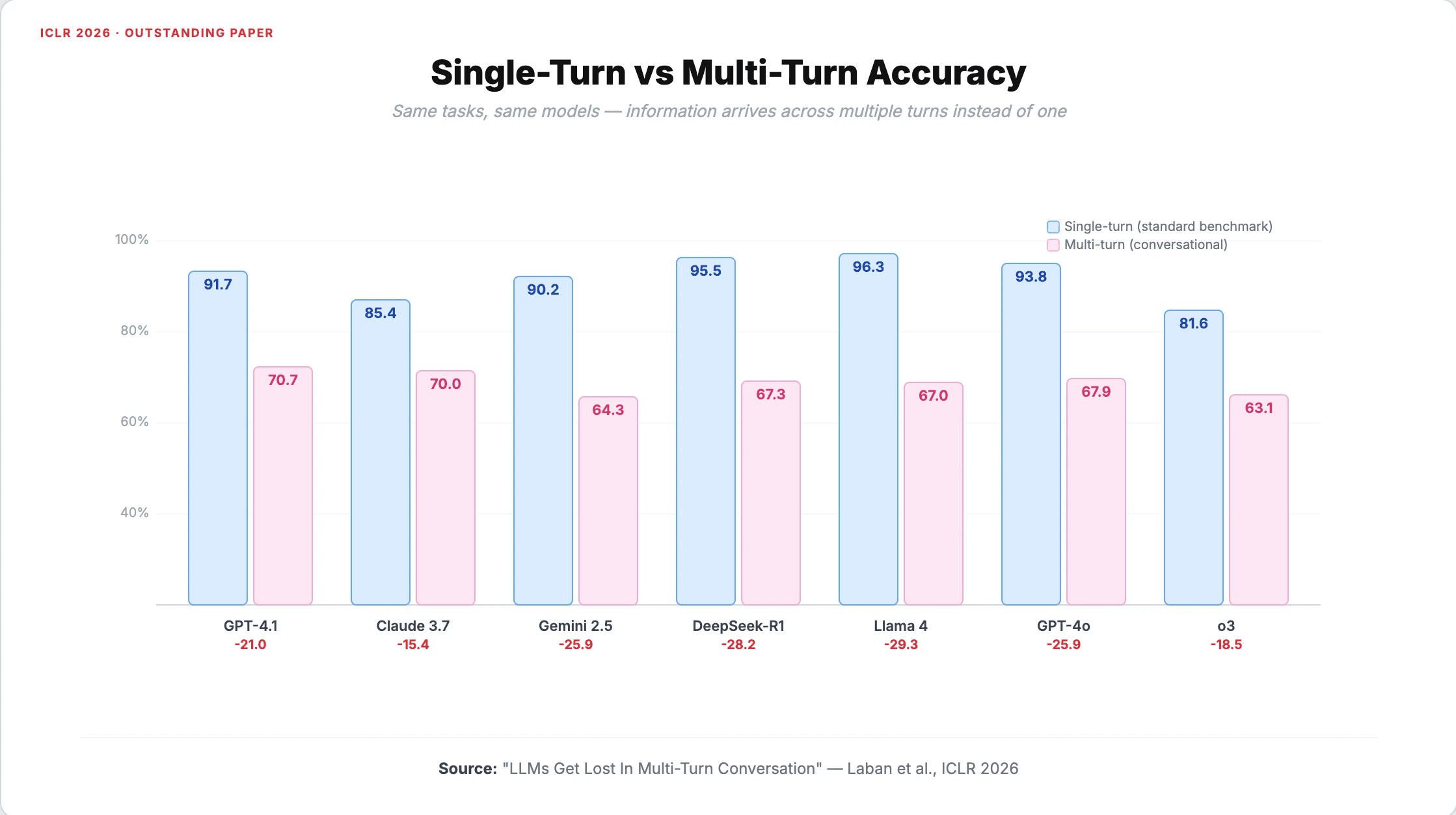

Die Ergebnisse waren konsistent. GPT-4.1 fiel von 91,7 % auf 70,7 %. Claude 3.7 Sonnet sank von 85,4 % auf 70,0 %. Gemini 2.5 Pro ging von 90,2 % auf 64,3 % zurück. Größere, leistungsfähigere Modelle zeigten keinen nennenswerten Vorteil darin, der Verschlechterung zu widerstehen. Der Rückgang war strukturell bedingt, nicht auf eine Fähigkeitslücke zurückzuführen.

Ein entscheidendes Kontroll-Experiment schloss die naheliegende Erklärung aus. Als dieselben Informationen in einer einzigen Nachricht zusammengefügt statt über mehrere Turns verteilt wurden, erholte sich die Leistung auf 95 % des Ausgangsniveaus im Ein-Turn-Setting. Nicht die Information selbst war das Problem, sondern das mehrstufige Interaktionsmuster.

Der Einbruch der Zuverlässigkeit ist gravierender als der Genauigkeitsrückgang

Die Schlagzeile unterschätzt das eigentliche Problem. Die Forscher zerlegten die Leistung in zwei Komponenten: Fähigkeit, also wie gut das Modell im Durchschnitt abschneidet, und Zuverlässigkeit, also wie konsistent diese Leistung ist.

Die Fähigkeit sank um 16 %. Die Zuverlässigkeit brach um 112 % ein.

Dieser Unterschied ist für alle, die KI-Agenten im Produktivbetrieb betreiben, enorm wichtig. Mehrstufige Gespräche machen Modelle nicht nur im Schnitt etwas schlechter. Sie machen Modelle extrem inkonsistent. Derselbe Agent, der dieselbe Aufgabe ausführt, kann einmal brillant erfolgreich sein und beim nächsten Mal vollständig scheitern. Die Differenz zwischen dem 90. und dem 10. Perzentil lag im Mittel bei rund 50 Prozentpunkten in mehrstufigen Settings.

Für Unternehmenseinsätze, bei denen Vorhersagbarkeit wichtiger ist als Spitzenleistung, ist das die gefährlichere Erkenntnis.

Vier Arten, wie LLMs im Gespräch versagen

Das Paper identifizierte vier unterschiedliche Fehlermodi, die jeweils direkte Auswirkungen auf das Agentenverhalten in der Produktion haben.

1. Verfrühte Antwortversuche. Modelle erzeugen bereits in den ersten 20 % eines Gesprächs vollständige Antworten, wenn sie nur minimale Informationen haben. Genauigkeit bei verfrühten Versuchen: 30,9 %, verglichen mit 64,4 %, wenn die Modelle auf mehr Kontext warteten. In Agenten-Workflows zeigt sich das darin, dass das System Entscheidungen trifft, bevor genügend Informationen gesammelt wurden, und dann selbstbewusst auf falschen Annahmen aufbaut.

2. Antwortaufblähung. Die Antwortlänge bläht sich über die Turns hinweg auf. Code-Ausgaben stiegen von rund 700 auf 1.400 Zeichen. Modelle hängen an ihre früheren, oft falschen Ausgaben an, statt neu anzufangen. Kürzere Antworten schnitten bei fünf von sechs Aufgaben um 10 bis 50 % besser ab. Für Agenten verschlechtern sich die Outputs im Verlauf der Gespräche, weil das Modell Korrekturen auf Fehler aufsetzt, statt von Grund auf neu zu überlegen.

3. Lost-in-the-Middle-Effekt. Modelle richten ihre Aufmerksamkeit überproportional auf Informationen aus dem ersten und dem letzten Turn. Verweise auf mittlere Turns fielen unter 20 %. Für Agenten, die Anforderungen sammeln, APIs aufrufen und Ergebnisse über viele Schritte hinweg verarbeiten, wird der im Mittel eines Workflows offenbarte kritische Kontext effektiv ignoriert.

4. Sich verstärkende Fehler ohne Recovery. Sobald ein Modell sich in einem Gespräch früh auf eine falsche Annahme festlegt, korrigiert es sich nicht selbst. Die Forscher beschreiben es ganz klar: „Wenn LLMs in einem Gespräch die falsche Abzweigung nehmen, verlieren sie sich und finden nicht zurück.“ Ein falscher Schritt früh in einem mehrstufigen Workflow verstärkt sich über jeden nachfolgenden Schritt, und der Agent signalisiert nicht, dass etwas schiefgelaufen ist.

Dieser letzte Fehlermodus entspricht direkt dem, was Produktteams als stillen Fehler bezeichnen: ein Agent liefert eine selbstbewusste, sauber formatierte, völlig falsche Ausgabe, die einer oberflächlichen Prüfung standhält.

Warum Benchmarks Käufer von Agenten in die Irre führen

Das Paper quantifiziert eine Lücke, die Käufer von Unternehmens-KI zwar gespürt, aber nur schwer in Worte gefasst haben. Ein LLM erzielt 92 % bei HumanEval. Dasselbe Modell, das dieselbe Coding-Aufgabe in einem mehrstufigen Gespräch erledigt, in dem Anforderungen schrittweise eintreffen (also so, wie ein realer Nutzer oder ein System damit interagiert), fällt in den niedrigen 70er-Bereich.

Ein-Turn-Benchmarks testen ein Szenario, das in der Produktion fast nie vorkommt. Enterprise-Agenten gehen mit Mehrdeutigkeit um, sammeln Informationen über mehrere Turns hinweg, rufen externe Tools auf und verdichten Teilergebnisse. Jede Interaktion erhöht die Zahl der Turns. Jeder Turn erhöht das Risiko.

Deshalb führt die Modellauswahl allein auf Basis von Benchmark-Ranglisten in die Irre. Das Modell, das eine Single-Turn-Rangliste anführt, ist nicht zwingend das Modell, das sich in einem 15-Turn-Agenten-Workflow am besten schlägt. Die Bewertung muss an die Einsatzbedingungen angepasst werden, und für die meisten Unternehmens-Anwendungsfälle ist der Einsatz mehrstufig.

Was sich dagegen tun lässt

Die Studie testete zwei Minderungsstrategien. Ein „Recap“-Ansatz, bei dem das Modell alle angesammelten Informationen zusammenfasst, bevor es eine finale Antwort erzeugt, verbesserte GPT-4o-mini von 50,4 % auf 66,5 %. Ein „Snowball“-Ansatz mit turnweiser Rekapitulation zeigte moderatere Zugewinne. Keiner von beiden schloss die Lücke zur Ein-Turn-Performance vollständig.

Für Teams, die Agenten bauen, ergeben sich aus diesen Erkenntnissen mehrere architektonische Entscheidungen.

Kontextkonsolidierung vor der Generierung. Statt sich auf den rohen Gesprächsverlauf zu verlassen, sollten Kontextblöcke an Kontrollpunkten komprimiert und zusammengefasst werden, bevor das Modell Ausgaben erzeugt. Das adressiert direkt das Lost-in-the-Middle-Problem und reduziert die Angriffsfläche für sich verstärkende Fehler.

Multi-Modell-Routing nach Aufgabenmerkmalen. Manche Aufgaben sind anfälliger für Verschlechterungen in mehrstufigen Gesprächen als andere. Das Paper stellte fest, dass Übersetzungsaufgaben, die Satz für Satz erledigt werden können, keine Verschlechterung zeigten. Aufgaben, die die Zusammenführung von Informationen über mehrere Turns hinweg erfordern, verschlechterten sich deutlich. Teilaufgaben an verschiedene Modelle weiterleiten – basierend auf ihrer Robustheit gegenüber mehrstufigen Gesprächen – führt zu verlässlicheren Ergebnissen, als für alles ein einziges Modell zu wählen.

In mehrstufigen Settings evaluieren. Wenn Ihr Agent mehrstufige Workflows ausführt, sollte auch Ihre Evaluierungssuite mehrstufige Workflows testen. Die Genauigkeit im Ein-Turn-Setting ist kein verlässlicher Stellvertreter für die Produktionsleistung.

Recovery-Mechanismen aufbauen. Da Modelle sich nicht selbst korrigieren, wenn sie vom Kurs abkommen, brauchen Agenten externe Checkpoints, Validierungsgates und selbstlernende Feedbackschleifen, statt darauf zu vertrauen, dass das Modell seine eigenen Fehler erkennt.

Die Lücke zwischen Training und Einsatz

Das ICLR-Komitee wählte dieses Paper aus, weil es das adressiert, was es als „dissonante Lücke“ zwischen dem Training von LLMs und ihrem Einsatz bezeichnete. Die Trainingsdaten sind überwiegend Single-Turn. Die Nutzung in der Produktion ist überwiegend Multi-Turn. Die Lücke zwischen diesen beiden Settings führt zu einem Genauigkeitsrückgang von 39 % und einem Einbruch der Zuverlässigkeit um 112 %.

Für Teams, die KI-Agenten evaluieren, ist die Schlussfolgerung eindeutig: Benchmark-Leistung zeigt Ihnen, was ein Modell unter idealen Bedingungen leisten kann. Eine mehrstufige Evaluation zeigt Ihnen, was es in Ihrer Umgebung tatsächlich tun wird.